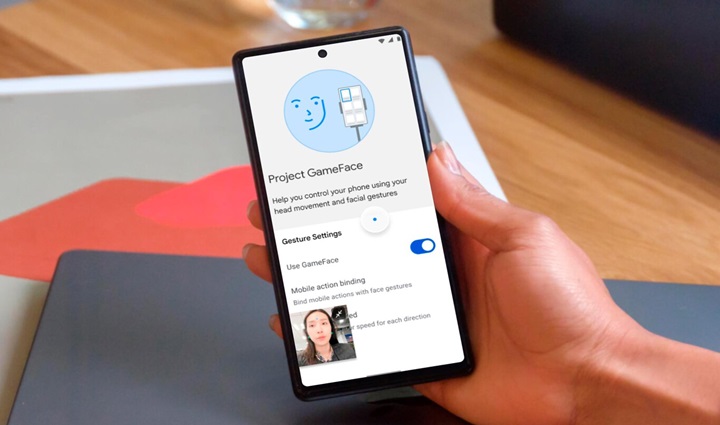

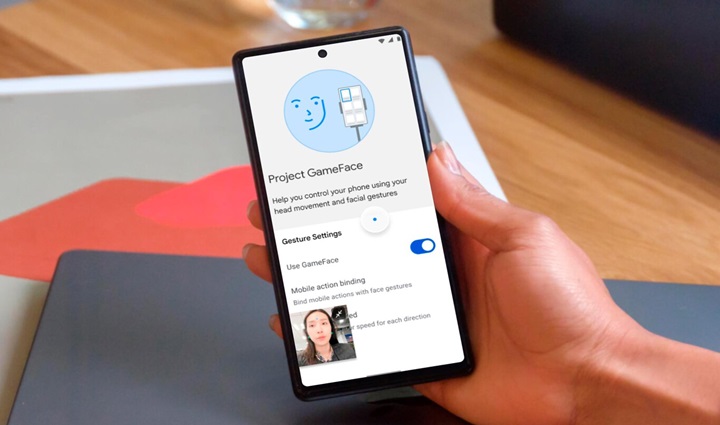

Google lanzará una nueva función que permitirá controlar tu móvil Android utilizando el reconocimiento facial. Este innovador proyecto se llama Project Gameface

23 de Mayo de 2024

Google utiliza la cámara frontal del smartphone para identificar gestos faciales, que se pueden asignar a diversas acciones.

En el evento Google I/O de 2024, además de las múltiples novedades sobre IA y Android 15, se hizo un anuncio importante que pasó desapercibido: el lanzamiento de Project Gameface. Esta tecnología permite a los usuarios controlar aplicaciones en Android solo con movimientos faciales. Similar a una función que Apple lanzará con iOS 18, Project Gameface es una herramienta de accesibilidad innovadora.

Google describe Project Gameface como un "ratón" que permite a las personas mover el cursor del ordenador usando la cabeza y los gestos faciales. Por ejemplo, los usuarios pueden abrir la boca para mover el cursor o levantar las cejas para hacer clic y arrastrar elementos, según explica la compañía en su blog.

El sistema utiliza la cámara frontal del dispositivo para reconocer los gestos faciales del usuario y asociarlos con acciones específicas, como sonreír para hacer clic. Además, Project Gameface permite personalizar la intensidad y la velocidad de los gestos, ajustándose a las necesidades individuales del usuario.

Google ha estado trabajando en este proyecto durante un tiempo y lo está integrando en Android a través de una API de MediaPipe. Esta API ofrece soluciones de inteligencia artificial y aprendizaje automático para la detección de rostros y puntos de referencia, y es capaz de reconocer más de 52 gestos faciales.

Actualmente, Project Gameface de Google está disponible en GitHub, lo que permite a los desarrolladores implementarlo fácilmente en sus aplicaciones.

Aunque no es exactamente la misma tecnología, Apple también ha presentado una nueva función de accesibilidad en iOS que permitirá a los usuarios controlar el sistema y algunas aplicaciones usando solo la mirada.

Esta función, que estará disponible con iOS 18 y iPadOS 18, utiliza la cámara frontal del dispositivo. Apple ha confirmado que con el seguimiento ocular, los usuarios pueden navegar por los elementos de una aplicación y usar la permanencia para activar cada elemento, accediendo a funciones adicionales como botones físicos, deslizamientos y otros gestos solo con los ojos.

Escrito por: Daniel Martín

⇒Foto: Xataka Android

En el evento Google I/O de 2024, además de las múltiples novedades sobre IA y Android 15, se hizo un anuncio importante que pasó desapercibido: el lanzamiento de Project Gameface. Esta tecnología permite a los usuarios controlar aplicaciones en Android solo con movimientos faciales. Similar a una función que Apple lanzará con iOS 18, Project Gameface es una herramienta de accesibilidad innovadora.

En el evento Google I/O de 2024, además de las múltiples novedades sobre IA y Android 15, se hizo un anuncio importante que pasó desapercibido: el lanzamiento de Project Gameface. Esta tecnología permite a los usuarios controlar aplicaciones en Android solo con movimientos faciales. Similar a una función que Apple lanzará con iOS 18, Project Gameface es una herramienta de accesibilidad innovadora. Actualmente, Project Gameface de Google está disponible en GitHub, lo que permite a los desarrolladores implementarlo fácilmente en sus aplicaciones.

Actualmente, Project Gameface de Google está disponible en GitHub, lo que permite a los desarrolladores implementarlo fácilmente en sus aplicaciones.